|

Новые модели:

Huawei Mate 30 Pro

Huawei Mate 30

iPhone 11

iPhone 11 Pro

iPhone 11 Pro Max

Samsung Galaxy Note10+

Samsung Galaxy Note10

Honor 8S

BQ 2818 ART XL+

BQ 1846 One Power

Xiaomi Mi A3

Huawei P smart Z

Huawei Y5 (2019)

Huawei P30 lite

Samsung Galaxy A80 (2019)

Новые обзоры:

Samsung Galaxy S10 Lite

Samsung A51

Panasonic TOUGHBOOK P-01K

HTC Wildfire E1 и E1 Plus

Redmi Note 8T

Vivo V17

Samsung A20s 2019

Oppo A9 2020

BQ Magic S

Philips S397

|

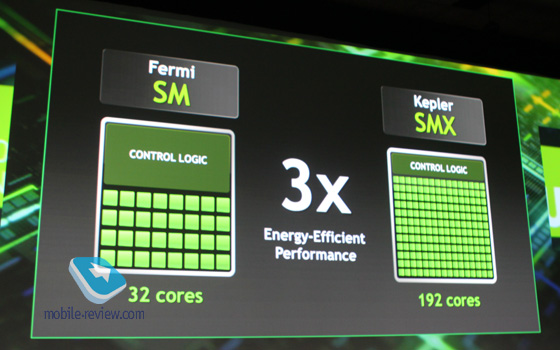

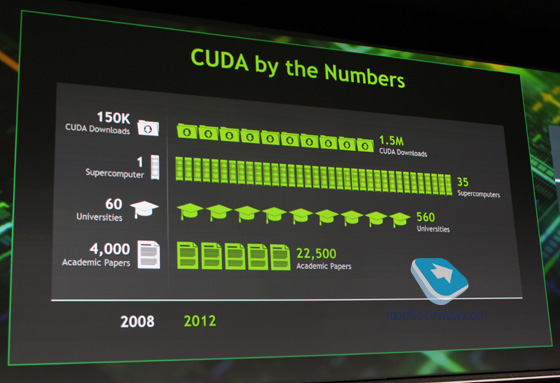

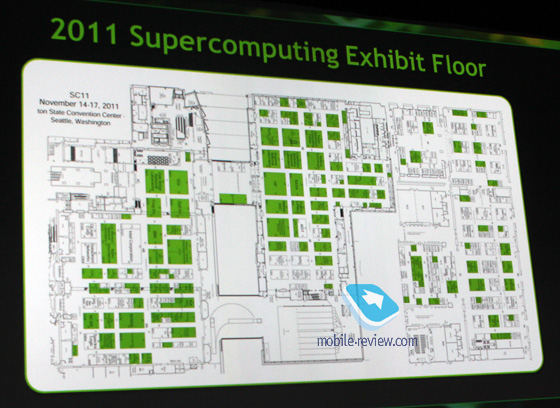

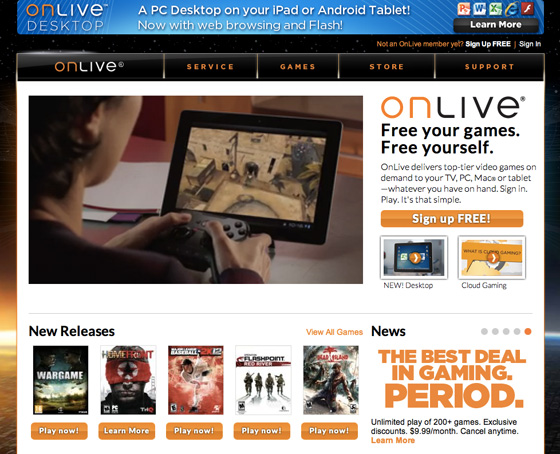

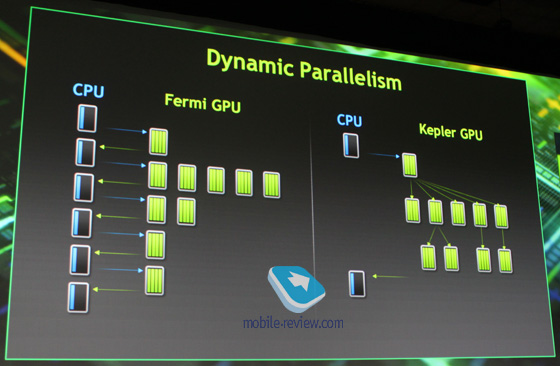

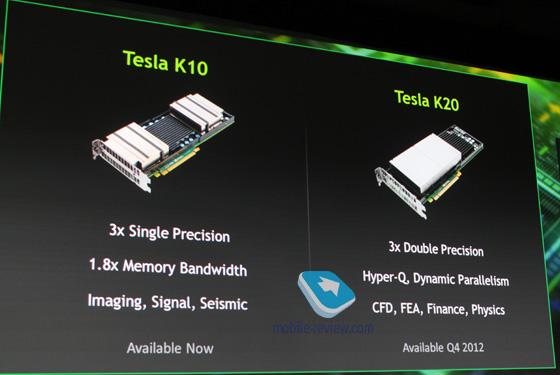

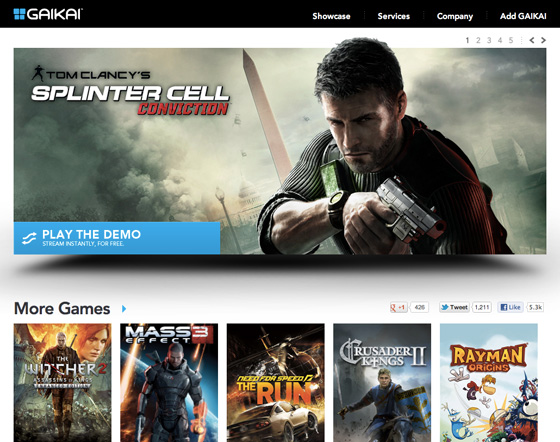

NVIDIA – конференция GTC, или разговоры о будущем игр и вычисленийВ Сан-Хосе компания NVIDIA проводит свою ежегодную конференцию GTC, название которой расшифровывается так – GPU Technology Conference. Как следует из имени, эта конференция посвящена графическим ускорителям и всем технологиям вокруг них. Сразу хочу предупредить, что эта статья - не для тех, кто ищет спецификации новых железок и вчитывается до последней запятой в характеристики. Мне это просто неинтересно, так как железки не вечны, их время быстро проходит. На мой вкус, надо говорить о тех изменениях, что NVIDIA пытается привнести в мир, как изменить представление о том, что такое видеоускорители и для чего они могут использоваться. Одно из изменений, которым уже никого не удивишь - это превращение графических ускорителей в суперкомпьютеры, которые могут обсчитывать сложные математические модели. В NVIDIA создали новый рынок, который базируется на возможностях обычных графических ускорителей, где слово «обычный» обозначает не конкретный продукт, а идею, стоящую за ним. Словно перевернули понятийный аппарат, когда одно из периферийных устройств вдруг оказалось вовсе не таким заштатным, а с его помощью стали возможны сложные вычисления. Это одна из характеристик трехмерной графики, которая прожорлива в отношении вычислительной мощности, и развитие в этом направлении конкретных железок позволяет создавать суперкомпьютеры. Этим уже удивить невозможно, и если вы следите за рынком, то знаете, что суперкомпьютеры на базе графических ускорителей NVIDIA используются по всему миру, а один из них даже установлен в России (МГУ, Москва). Я специально привожу пример того, как в NVIDIA изменили представление о суперкомпьютерах, чтобы широкими мазками описать то, что в компании пытаются сделать своим следующим шагом. Ни много, ни мало - в очередной раз изменить наши представления о вычислениях и о том, что можно получить обычному пользователю в области трехмерной графики, даже не покупая специальный ускоритель или пользуясь программой на мобильном устройстве, например, телефоне или планшете, где установка такого ускорителя просто невозможна. В качестве аналогии на память приходит начало развития компьютерных технологий и эпоха мейнфреймов. В те времена компьютеры занимали огромные комнаты, а доступ к ним осуществлялся с терминалов (тонких клиентов). Позднее с появлением дешевых персональных компьютеров мы перешли к клиент-серверной модели, в которой сам клиент обладал вычислительными мощностями и был способен хранить информацию. Идея «тонкого» клиента, состоящего только из экрана и клавиатуры, с хранением данных на сервере, практически не прижилась, люди хотели хранить свои данные под рукой. Возможно, что не будь этого психологического блока, и мы увидели бы облачные технологии еще несколько десятков лет назад. С другой стороны, их появление невозможно без развития соответствующих технологий компрессии данных, инфраструктуры передачи данных, которая получила развитие только в последние десять лет и достигла минимально необходимого для этого уровня. То, что уровень минимален даже сегодня, легко увидеть, попытавшись восстановить из iCloud свой iPad, процесс может занять до нескольких дней, счастливчики успевают сделать это за несколько часов. Хотя размер копии очень мал, и локально со своего ноутбука или ПК вы можете восстановить его за десять минут. Ограничением выступают размеры дата-центров, а также пропускная способность каналов. Но все постепенно меняется, и с 2011 года вновь начинается активное развитие облачных сервисов, которые под другим углом продвигают всю ту же идею удаленного хранения данных. Давайте попробуем еще немного развить эту идею. Если в облаке можно хранить ваши данные, то почему нельзя туда вынести и вычислительную мощность вашего компьютера? Это идея эпохи мейнфреймов, и мы знаем, что она работает. За последний десяток лет появилось множество технологий виртуализации рабочего стола, в том числе VDI-технологий (Virtual Desktop Infrastructure). Очень упрощенное объяснение того, как это работает – весь ваш софт находится на сервере, а вам транслируется картинка, с помощью которой вы и работаете. Необходимое условие только одно – вам необходим доступ в сеть, чтобы получать данные. Качественные характеристики интернет-канала не поражают воображения, не требуется никаких выделенных линий или чего-то подобного. На ум сразу приходят фантастические книги, в которых подобная технология описывалась многократно. Отважный исследователь (интересно, бывают ли другие в таких книгах?) натыкается на что-то неизвестное на только что открытой планете, передает данные на корабль, который и проводит их анализ. Ничего не напоминает? Фактически, мы сталкиваемся с той же архитектурой, когда есть «тонкий» клиент (у нас это исследователь), а также сервер (корабль). И все упирается исключительно в возможности связи между ними. Отвлекусь на минуту в сторону и скажу, что в недалеком будущем станут востребованы технологии как защиты каналов передачи данных, в основном эфирных, так и их уничтожения (постановка помех). Если говорить о военных технологиях, то флоты и армии будут объединяться в некую виртуальную сеть, в которой ключевым элементом станут дата-центры, прогнозирующие те или иные действия противника. В отличие от гражданских применений, боевые единицы техники будут оснащаться мощными локальными компьютерами, чтобы иметь возможность действовать и в условиях недоступности общей армейской сети. Но хватит о недалеком будущем, давайте посмотрим в день сегодняшний. В NVIDIA вновь решили подменить понятия в хорошем смысле этого слова и предложили технологию NVIDIA VGX (GPU-VDI), в которой виртуализация рабочего пространства достигается, как вы уже догадались с помощью графических ускорителей. На стороне дата-центра устанавливаются графические ускорители NVIDIA – они используют архитектуру Kepler, это последнее поколение от NVIDIA на сегодняшний день. Доступ к этим ускорителям может получать множество пользователей одновременно, каждый получит то количество вычислительной мощности, что ему нужно. Эффективность такого решения трудно переоценить, де-факто мы избавляемся от необходимости создания на каждом рабочем месте производительной станции, отдавая все вычисления в облако. Другой момент, который связан с энергоэффективностью, очень важен – сегодняшние дата-центры крупнейших компаний, таких как Google, Microsoft, Amazon, дошли до предела по выделению тепловой энергии. С ростом вычислительных мощностей затраты на охлаждение оборудования резко возрастают, что делает линейное расширение числа стоек с серверами невозможным, тут требуется эффективность. Интересно, считал ли кто-то, сколько тепловой энергии сегодня излучают в окружающую среду все компьютеры и устройства на Земле, думаю, что число будет огромным. Другим ограничением становится невозможность линейного расширения из-за отсутствия достаточного количества энергии для питания дата-центров, они потребляют больше, чем многие промышленные предприятия, но располагаются вблизи от потребителей (то есть, вне промышленных зон). Например, в Москве я помню, с каким трудом Yandex искал территорию для своего дата-центра, так как необходимое количество энергии было найти крайне сложно. Ровно с той же проблемой столкнулся российский офис NVIDIA, в котором находится большой дата-центр, а также центр тестирования программного обеспечения (преимущественно игр). При поиске места для офиса основным критерием стала энерговооруженность здания, а его местоположение отошло на второй план. Итак, технология виртуального рабочего стола от NVIDIA зиждется на графическом ускорителе, который подключается через разъем PCI Express к серверу. Одна плата содержит 4 GPU и 16 ГБ памяти, она позволяет обслуживать до ста пользователей (впрочем, тут вопрос того, что это минимальная конфигурация, а не тяжелые вычисления). Возможно объединение NVIDIA VGX с помощью программной технологии GPU Hypervision, она интегрирует железо в программные продукты других компаний, например, Citrix XenServer, добиваясь таким образом виртуализации GPU. Наконец, на уровне предоставления услуги конечным потребителям присутствует технология User Selectable Machines (USM). С ее помощью администратор корпоративной сети может давать приоритет той или иной машине, одновременно создавая для нее иные возможности. Например, в самом облегченном варианте это будет обычная графика, характерная для бизнес-приложений, в промежуточном ее качество вырастет, как и количество дополнительных функций. Посмотрите на табличку, чтобы увидеть отличия, думаю, из нее все станет понятно. Фактически, мы говорим о том, что используя эту технологию, художники и дизайнеры смогут обрабатывать тяжелые файлы почти на любом железе, реальные расчеты будут идти на сервере, где установлен NVIDIA VGX. Это и дает основные отличия текущей технологии от того, что мы видели до сегодняшнего дня. Тут я немного лукавлю, так как технологии виртуальных рабочих столов известны давно и используются многими компаниями, равно как и серверные вычисления, например, учебными центрами, исследователями и так далее. Новизна предложения NVIDIA только в том, что компания играет на своем поле, предлагая впервые получить отличные возможности для графики вне зависимости от вашего реального железа (тут есть, безусловно, некоторые физические ограничения, например, если у вас дисплей имеет низкое время отклика, то поиграть на нем не получится). Фактически, впервые виртуальные рабочие столы получили графику на уровне хороших и привычных ПК. Впервые становится возможным получить соответствующего уровня графику на мобильных устройствах, например, планшетах. По-другому этого сделать нельзя, так как установить в планшет мощную графическую карту невозможно – всегда будет сохраняться разрыв между уровнем карт в отдельно стоящих ПК и их мобильных вариантах, где требуется пониженное энергопотребление. Впрочем, давайте взглянем на несколько демонстрационных видео от NVIDIA, я думаю, что они говорят сами за себя, и если это станет возможным для планшетов, то можно говорить о принципиально новых возможностях развития рынка. В какой-то мере мы делаем еще один шаг к инфраструктуре, в которой устройство, находящееся в ваших руках, будет становиться менее мощным, но долгоживущим, а основной его характеристикой станут экран и толстый канал для передачи данных. Технологии, о которых мы поговорили, уже существуют, это не демонстрационные версии, и они начнут разворачиваться в коммерческом варианте уже во второй половине 2012 года. Как вы видите, в NVIDIA стараются занять все ниши, связанные как с графикой, так и со смежными областями. Например, представленные технологии интересны не только для виртуализации рабочих столов, но это составляющая суперкомпьютеров, замена существующих GPU, с более эффективной обработкой данных (CUDA технология).  И, на мой взгляд, очень говорящий слайд, это то, сколько исследователей использовали подобные вычисления в 2006 году и сколько из них используют их сегодня.    Виртуальная игровая приставка на вашем ПК, телевизоре и планшетеЗнаете, какая основная проблема в игровой индустрии для консолей? Это достаточно медленное развитие аппаратной части консолей и необходимость ориентироваться на их долгий жизненный цикл, а также продавать эти консоли за небольшие деньги, получая прибыль от игр. Создавая игровую приставку, производитель должен заложить определенный запас прочности, так как невозможно обновлять модель ежегодно. Пожалуй, это и дает возможность индустрии ПК успешно противостоять нашествию консолей, здесь гибкость установки новых видеокарт выше. Но и тут основная проблема в том, что у большинства потенциальных покупателей игр нет последнего железа, что сокращает число возможных продаж новейшей игрушки. Либо заставляет разработчиков тратиться на то, чтобы создавать версии под различное железо, что выливается в отдельные деньги и нервы. Узким местом, как обычно, становится графика. Теперь давайте представим, что у вас есть возможность не покупать новейшее железо, но при этом вы можете играть в различные игры со своего средненького ПК. Такой сервис уже существует, это www.onlive.com. Вы получаете возможность играть в последние игры на телевизоре, планшете, телефоне, вашем ноутбуке. Здесь используется вариант подписки, вы можете за 10 долларов в месяц играть неограниченное число раз в некий набор игр. Для отдельных игр может использоваться другой вариант оплаты, но механика должна вам быть понятна, вы не платите за копию игры, а подключаетесь к серверу Onlive.  Недостатком этой первой ласточки становится задержка при подключении и удаленность серверов, играть в некоторые игры становится тяжело, а для профессиональных игроков этот сервис пока и вовсе неприменим. Однако у него есть несколько преимуществ. Во-первых, вопрос пиратства для правообладателей просто не стоит. У игрока нет локальной копии игры, все хранится на сервере, и украсть что-либо невозможно. Во-вторых, играть можно с различных устройств, ваш идентификатор привязан только к тому, что вы купили. И, на мой взгляд, это также огромное отличие от классической модели. Например, играть в игру на консоли и на ПК одновременно тяжело и не нужно, как правило, ваш прогресс не сохраняется. Тут же все возможно. В NVIDIA не стали изобретать велосипед, а предложили рынку ровно то же самое, но с рядом характерных отличий относительно графики. Технология называется GeForce Grid, фактически, это тот же Kepler, но использующийся для трансляции игр и обработки их графики. Коренное отличие от Onlive или любого иного облачного сервиса в том, что поток выдается напрямую, каждый игрок получает его с самого графического ускорителя, который имеет собственный IP-адрес. Процессор здесь отходит на второй план, что позволяет резко сократить задержки при передаче картинки на конечное устройство.    Надо понимать, что чудес не бывает, и GeForce Grid - это улучшение уже знакомых и существующих технологий. Как обычно, для NVIDIA здесь все построено вокруг графики. Во время демонстрации нам показывали трехмерную игру, в которой можно быстро и реалистично передвигаться. Понятно, что это демонстрация и в реальной жизни все вновь будет упираться в канал, а также то, где расположены сервера, какое у вас интернет-соединение (достаточно среднего, но обрывы связи здесь недопустимы).  В NVIDIA заявили, что GeForce Grid будет использоваться целым рядом компаний, кто предоставляет облачные игры, например, это будет www.gaikai.com, один из сильных игроков в этой области.  В качестве небольшого резюмеНе так важно выстрелят ли технологии от NVIDIA во всех аспектах, или нет. В большинстве дата-центров, кто предоставляет удаленные мощности для вычислений, уже применяется GPU от NVIDIA. Этот рынок сформировался из ниоткуда, и он продолжает расти, огромное число компаний, работающих в разных областях, охочи до вычислений. На текущей конференции GTC компания ясно дала понять, что ей интересно играть и на рынке для конечных потребителей, что логично. Предоставив технологии для дата-центров, в NVIDIA сделали следующий шаг – адаптировали эти технологии для корпораций (VDI), а также попытались сделать соответствующий продукт для конечных потребителей (удаленные игры). По моему мнению, вне зависимости от того, как будет развиваться рынок, в NVIDIA обезопасили свое будущее. Выиграет вновь концепция локальных ПК, пригодятся отдельные графические ускорители. Взорвется рынок облачных игр, и тут у компании есть свое предложение. Но главное, что мне показалось очень важным, это то, что изменяется парадигма рынка. Облачные вычисления - это новое имя для старых технологий, и единственным ограничением для их распространения является боязнь пользователей доверить облаку критический объем данных. Вопрос только в том, смогут ли разные компании переломить эти убеждения, или нет. Например, я не готов отдавать в облако свои данные, кроме как в качестве защищенных резервных копий или небольших сервисов (синхронизация календарей, дел и так далее). А вы готовы? С другой стороны, я с удовольствием готов потреблять игры из облака, если их качество будет высоким и я не увижу разницы между локальной копией игры и таковой на сервере. Также я вполне буду доволен, если мне не нужно будет покупать Adobe Photoshop для редактирования двух-трех файлов в течение года, а я смогу заплатить за его использование тогда, когда он мне нужен. И плата будет привязана к тому объему работы, что я проделаю (это может быть обработка файла, а может быть и его размер, моделей монетизации тут может быть очень много). Факт в том, что новый/старый рынок переходит к другим точкам отсчета и в ближайшее время универсальным мерилом для этих расчетов может стать час процессорного времени, а не что-то иное. Представляете рекламу, в которой тот же Adobe говорит о том, что программа лучше, так как тратит меньше процессорного времени? Примерно как реклама современных экономичных автомобилей. Безусловно, это пока мечты или воображение о будущем, но мы приближаемся к нему очень быстро, я бы даже сказал, что мы в него мчимся, не оглядываясь по сторонам. Буду признателен, если вы выскажете свое мнение об облачных сервисах, ваше мнение о них, доверяете или нет, и так далее, здесь в комментариях. Интересно, что вы думаете на эту тему. Эльдар Муртазин (eldar@mobile-review.com) Поделиться: Мы в социальных сетях: Есть, что добавить?! Пишите... eldar@mobile-review.com

|

Новости: 13.05.2021 MediaTek представила предфлагманский чипсет Dimensity 900 5G 13.05.2021 Cайты, имеющие 500 тысяч пользователей из России, должны будут открыть местные филиалы 13.05.2021 Amazon представила обновления своих умных дисплеев Echo Show 8 и Echo Show 5 13.05.2021 МТС ввел удобный тариф без абонентской платы - «МТС Нон-стоп» 13.05.2021 Zenfone 8 Flip – вариант Galaxy A80 от ASUS 13.05.2021 Поставки мониторов в этом году достигнут 150 млн 13.05.2021 Состоялся анонс модной версии «умных» часов Samsung Galaxy Watch3 TOUS 13.05.2021 Tele2 выходит на Яндекс.Маркет 13.05.2021 OPPO представила чехол для смартфона, позволяющий управлять устройствами умного дома 13.05.2021 TWS-наушники с активным шумоподавлением Xiaomi FlipBuds Pro 13.05.2021 В России до конца следующего года появится госстандарт для искусственного интеллекта 13.05.2021 ASUS Zenfone 8 – компактный флагман на Snapdragon 888 12.05.2021 Компания Genesis представила внешность своего первого универсала G70 Shooting Brake 12.05.2021 В России разработан высокоточный гироскоп для беспилотников 12.05.2021 В Россию привезли новую версию смарт-часов HUAWEI WATCH FIT, Elegant Edition 12.05.2021 Раскрыты ключевые особенности смартфона POCO M3 Pro 5G 12.05.2021 Honor 50: стали известны дизайн и другие подробности о смартфоне 12.05.2021 Чипсет Exynos 2200 от Samsung будет устанавливаться и в смартфоны, и в ноутбуки 12.05.2021 МТС начала подключать многоквартирные дома к интернету вещей 12.05.2021 iPhone 13 будет толще и получит более крупные камеры по сравнению с iPhone 12 12.05.2021 Xiaomi договорилась с властями США об исключении из чёрного списка 12.05.2021 Xiaomi выпустила обновлённую версию умного пульта Agara Cube T1 Pro 12.05.2021 Игровые ноутбуки с NVIDIA GeForce RTX 3050 Ti уже в России! 12.05.2021 Индийский завод Foxconn сократил производство в два раза 12.05.2021 Lenovo отказалась от очного участия в предстоящем в июне Mobile World Congress Подписка |